생성형 인공지능(AI) 모델의 크기와 사용 방식에 따라 에너지 소비량과 탄소배출량이 크게 달라진다는 연구결과가 나왔다. 단순한 질문에는 작은 모델을 쓰는 것이 오히려 환경적으로 더 적절하다는 지적이다.

미국 에너지부는 지난해 보고서에서 AI 확산으로 데이터센터의 전력소비 비중이 2028년까지 12%로 늘어날 수 있다고 밝혔다. 이는 2022년 기준 4.4%보다 3배 가까이 늘어난 비중으로, 늘어나는 전력수요 때문에 석탄과 가스 발전소 가동이 증가할 수 있다.

독일 뮌헨응용과학대학의 박사과정 연구원 막시밀리안 다우너는 "모든 질문에 대형 모델을 쓸 필요는 없다"며 "작은 모델도 특정작업에 효과적으로 대응할 수 있다"고 밝혔다.

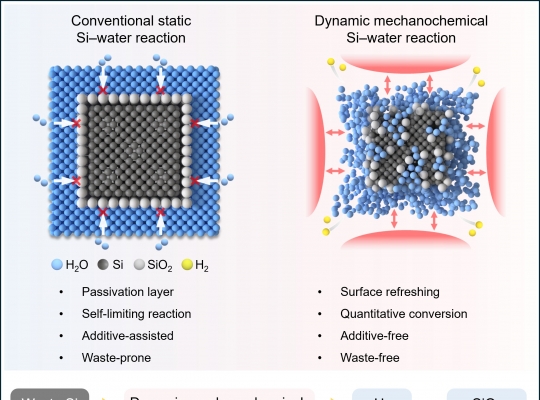

연구진은 14개의 오픈소스 대형언어모델(LLM)을 대상으로 수학, 역사 등 5개 분야에서 1000개의 질문을 던져 정확도와 전력 사용량을 비교했다. 응답에 사용된 전력을 이산화탄소 배출량으로 환산해 모델별 환경 영향을 평가했다.

논리 기반 과목의 경우, 답변이 길고 복잡해지면서 에너지 소비량도 많았다. 특히 사고과정을 단계적으로 드러내는 '추론형' 모델은 일반 모델에 비해 탄소배출량이 크게 높았지만, 정답률에서는 큰 차이가 없었다.

가장 많은 배출을 기록한 'DeepSeek-R1' 모델은, 그보다 배출량이 4분의 1 수준인 모델과 유사한 정확도를 보였다. 다우너는 "더 긴 답변과 복잡한 추론 과정이 더 많은 전력을 소모한다"고 설명했다.

AI 연구기관 앨런연구소의 제시 닷지는 "미국 중부와 노르웨이처럼 전력의 탄소집약도가 다른 지역에서는 같은 모델도 배출량이 3배 이상 차이날 수 있다"며, 연구 결과의 맥락적 해석을 강조했다.

AI 전문 기업 허깅페이스의 사샤 루시오니는 "중요한 건 과목이 아니라 입력과 출력의 길이"라며 "많은 상황에서 생성형 AI를 굳이 쓸 필요는 없다"고 말했다. 기존 검색엔진이나 계산기 같은 '고전적' 도구가 더 효율적일 수 있다는 것이다.

Copyright @ NEWSTREE All rights reserved.